- 23/06/2023

Midjourney, du machst mich fertig!

Zoom it out, Midjourney!

Ende März (shame on me) hab ich hier meinen letzten Beitrag beigesteuert. Auch da ging’s um KI bzw. Midjourney:

KI – Künstliche Intelligenz: Mach mal die Spieß

Seither hat sich schon wieder so viel getan. Die Bilder-KIs werden immer besser, können immer mehr. Erst gestern hab ich vom neuen Feature in Midjourneys Version 5.2 „Zoom Out“ gelesen – bin auf Facebook in der Gruppe „AI Art Universe“ darüber gestolpert, und die Ergebnisse waren einfach nur „WOOOHAAAA!!“ – Also musst ich das selbst ausprobieren.

Aber bevor ich euch meine Ergebnisse zeig, hier eine kurze Erklärung, wie man sich das vorstellen kann:

- Man generiert ein Bild wie bisher auch. Sprich: Über einen prompt eine Bildbeschreibung eingeben und generieren lassen.

- Man erhält wie immer vier Bilder zur Auswahl. Schließlich entscheidet man sich für eins davon und klickt auf „Upscale“

- Ist es hoch gerechnet, hat man die Möglichkeit, es „auszuzoomen“ – entweder im Faktor 1,5 oder 2 oder „custom“

- Und dann rechnet Midjourney rund um das Ausgangsbild weiter und generiert – je nach Zoomfaktor – noch weitere Bildinhalte dazu.

- *hysterischesLachenmeinerseits*

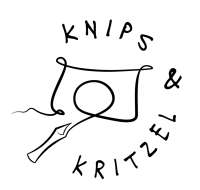

Testreihe 1: Hund im Park mit seinen gefiederten Freunden

Da hab ich also diese Möglichkeit und keine Bildidee. Also ganz schnell mal irgendwas, das mir in den Sinn kommt. Sowas wie „Hund sitzt im Park, beobachtet Vögel, Wasser, …“ – und dann erhalt ich schon das Ergebnis:

Mag ich. Auch, wenn einige der Tauben aussehen, als würden sie zu viel (und zu intim?) mit Flamingos rumhängen. Egal, ich nehm das mal als Ausgangsbild und los: „Zoom Out“ mit Zoom-Faktor 2. Hier die zwei folgenden Bilder inklusive Erweiterung, die von Midjourney hinzugefügt wurde:

Details wie der schiefe Turm im Hintergrund… naja.. aber man könnte sich ja auch hier weitere Variationen erstellen lassen oder das Ganze noch in Photoshop bearbeiten. Hab ich nur nicht. – Ungeduld und so 😉

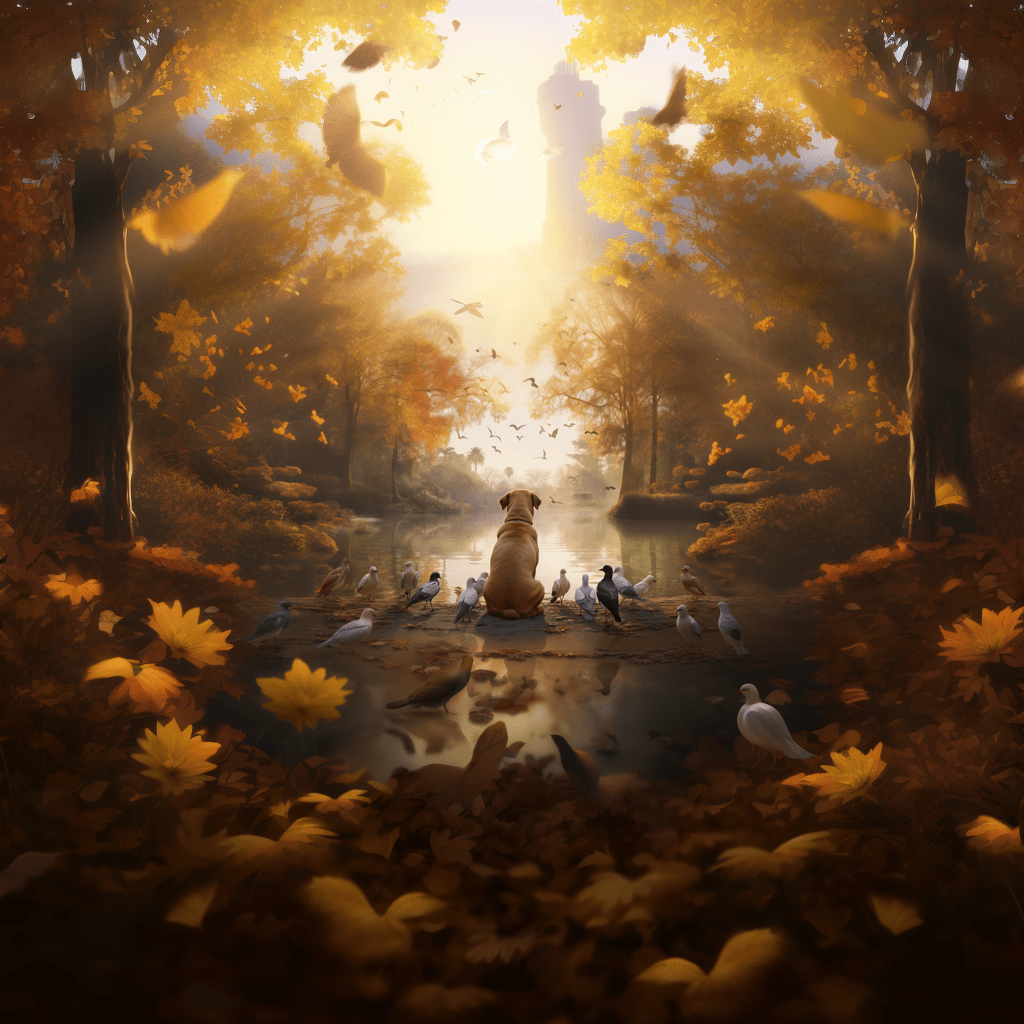

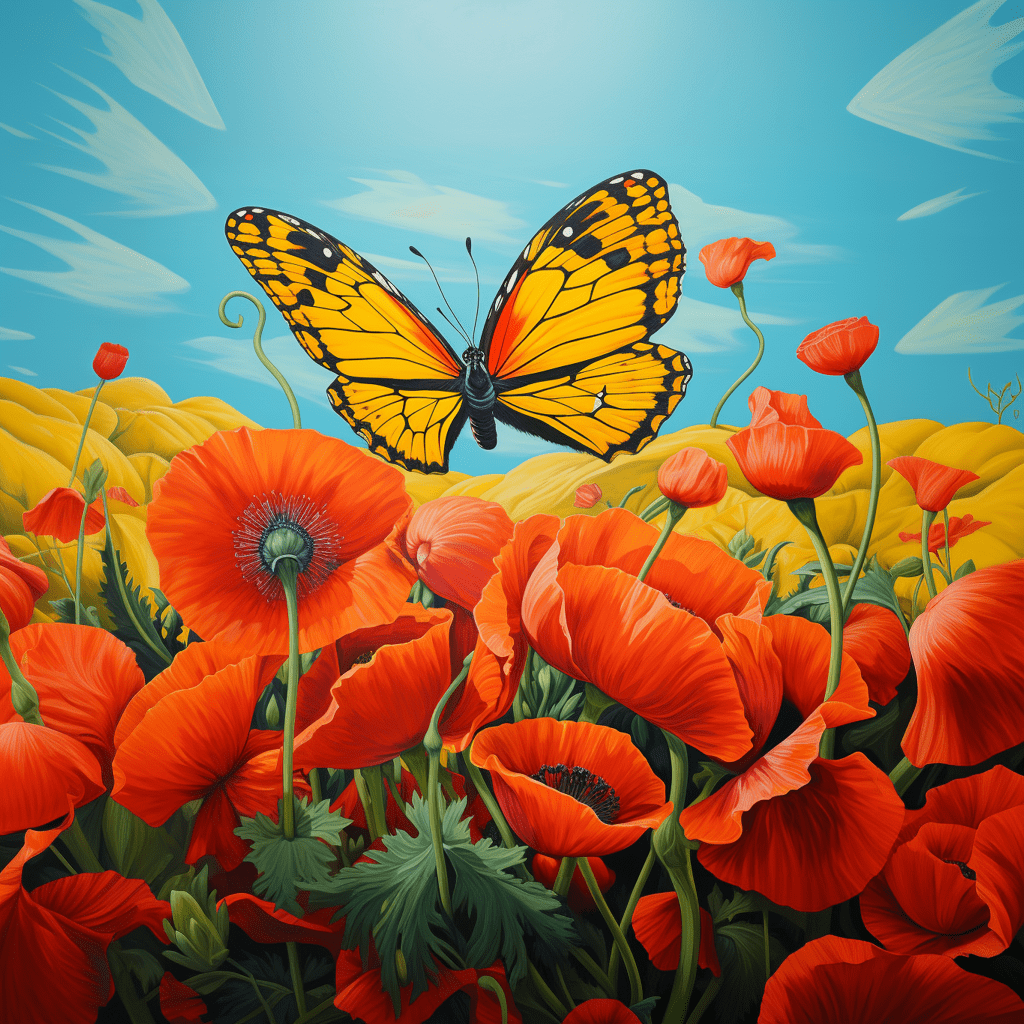

Testreihe 2: Schmetterling im Mohnblumenfeld

Ein paar Stunden später überleg ich wieder, was ich denn noch probieren könnte. Diesmal ein gelber Schmetterling, der über einem Mohnblumenfeld rumflattert. Zur Abkürzung zeig ich hier nur das erste und letzte Bild – hierfür hab ich den Zoomfaktor 1,5 gewählt. Fünf Schritte waren nötig, um zu diesen Ergebnis zu gelangen.

Ok, etwas langweilig, weil es auch ein sehr einfaches Motiv ist. Es wird einfach immer nur etwas mehr blauer Himmel, ein bisschen mehr Mohnblumen- und gelbes Feldzeugs hinzugefügt. *gähn*

Ich möcht was Kniffligeres…

Testreihe 3: Viele kleine Häuschen

Im Kopf hab ich diese Wimmelbilder, auf denen man ewig nach den gesuchten Gegenständen oder Figuren suchen muss, weil dermaßen viele minimini-Bildinhalte da sind, dass einem das Hirn raucht, wenn man nur kurz hinschaut.

Also, los: Aus welchem Fenster sieht der kleine Jimmy raus?

Soweit das Ausgangsbild. Und jetzt geht’s los… Zoom-Faktor 2, insgesamt fünf Schritte bis zu diesem Endergebnis:

In der Bildmitte, ganz hinten, kaum noch erkennbar – ja, genau. Da sitzt das Ausgangsbild. Irre, irre. Leider gibt Midjourney die Bilder nur in der Auflösung 1024×1024 heraus. Zumindest hätte ich da keine andere Information. Aber hoffen wir mal, dass sich das noch irgendwann ändert…

Der Himmel am finalen Bild ist vielleicht auch ein bisschen übertrieben mit der zusammenhängenden Wolkendecke. Etwas lockerer angeordnete Wolken, wie sie oberhalb der Bergspitzen beginnen, hätten mir besser gefallen. Ja, klar, Photoshop wär möglich gewesen, oder eben auch andere Variationen über Midjourney. Aber ja… ihr wisst ja: Die Spießsche Ungeduld 😉

Der Vollständigkeit halber hier auch noch die Zwischenschritte (jaja, ihr könnt zur größeren Ansicht drauf klicken):

P.S.: Zum kleinen Jimmy. – Ich hab keine Ahnung, ob da aus irgendeinem Fenster irgendwo irgendwer raussieht. Aber falls ihr gesucht habt und euch die Augen tränen: Sorry. Solltet ihr aber jemanden gefunden haben: Wo denn, bitte? – Danke.

Tja, was soll ich sagen...

Egal, ob Chatbots oder Bilder-KIs. Diese Dinger sind einfach nur verrückt. Ich weiß jetzt zwar auf Anhieb nicht, was ich mit ewig und unendlich ausgezoomten Bildern anfangen sollte. Aber irgendeinen Anwendungsfall gibt’s sicher. Glaub ich. Oder? Ich weiß es nicht.

Bisher ist es ja nicht möglich, nur Teile eines KI-generierten Bildes in der KI nochmals partiell zu überarbeiten. Vielleicht ist das aber einer der ersten Schritte in diese Richtung? Wenn ich genauer drüber nachdenk, ergibt das grad gar keinen Sinn. Es wird ja nichts verändert, sondern nur erweitert. Aber trotzdem glaub ich irgendwie, dass es in diese Richtung gehen wird. Irgendwann. Wann? Sicher früher als wir alle das denken. Adobe macht’s ja grad vor mit seiner Funktion „Generative Fill“ in der Beta-Version von Photoshop. (Jaja, dazu kommt noch ein Beitrag. Großes Pfadfinderehrenwort)

Teufelszeug, ehrlich! Trotzdem (oder deswegen) super-spannend.

"Bilder-KIs: Sie wachsen schneller als ein Gartenzwerg auf Superdünger

und bringen uns zum Staunen wie eine Herde Gummihühner auf Koffein!"ChatGPT